Runway Gen-4 AI 视频生成器

通过更聚焦的 Genverse AI 工作流,用 Runway Gen-4 生成质感更好的短视频,适合文本和单图创作。

在 Genverse AI 上用 Runway Gen-4 制作电影感 AI 视频

Runway Gen-4 适合对短视频质量有明确要求的团队:运动更自然、提示词遵循更稳、画面连续性更干净。在 Genverse AI 上,你可以在同一套工作流里完成 Runway Gen-4 的文生视频和图生视频创作。

Runway 发布 Gen-4 研究内容时,重点提到了它在基准测试上的领先表现,以及在物理真实感、复杂场景处理和角色动作表达上的明显进步。这个页面把这些能力拆解成可直接上手的实践建议,帮助创作者稳定产出可复用、可交付的 Runway 结果。

Runway Gen-4 的优势在哪里?

Runway 的研究示例展示了几项很关键的能力:更真实的动量表现、液体运动、更细腻的角色表情,以及在复杂场景下更清晰的镜头叙事。对于要做发布片、社媒内容、产品故事片和概念短片的团队来说,这些能力都很实用,因为视觉一致性往往和产出速度同样重要。Runway Gen-4 在镜头控制、运动逻辑稳定性和细节持续性上表现更强。

在 Genverse AI 上,Runway Gen-4 以清晰的生产流程组织,而不是零散的参数堆叠。这让团队更容易按目标迭代、快速横向对比版本,并把质量判断始终对齐到最终发布渠道。

Runway Gen-4 结果更稳的核心能力

这些特性让 Runway Gen-4 更适合真实创作与交付流程。

提示词遵循更稳,物理逻辑更自然

Runway 对细节镜头指令的执行更稳定,尤其在提示词涉及重量、受力、动量或流体运动时更明显。这样团队对首轮生成结果会更有把握。

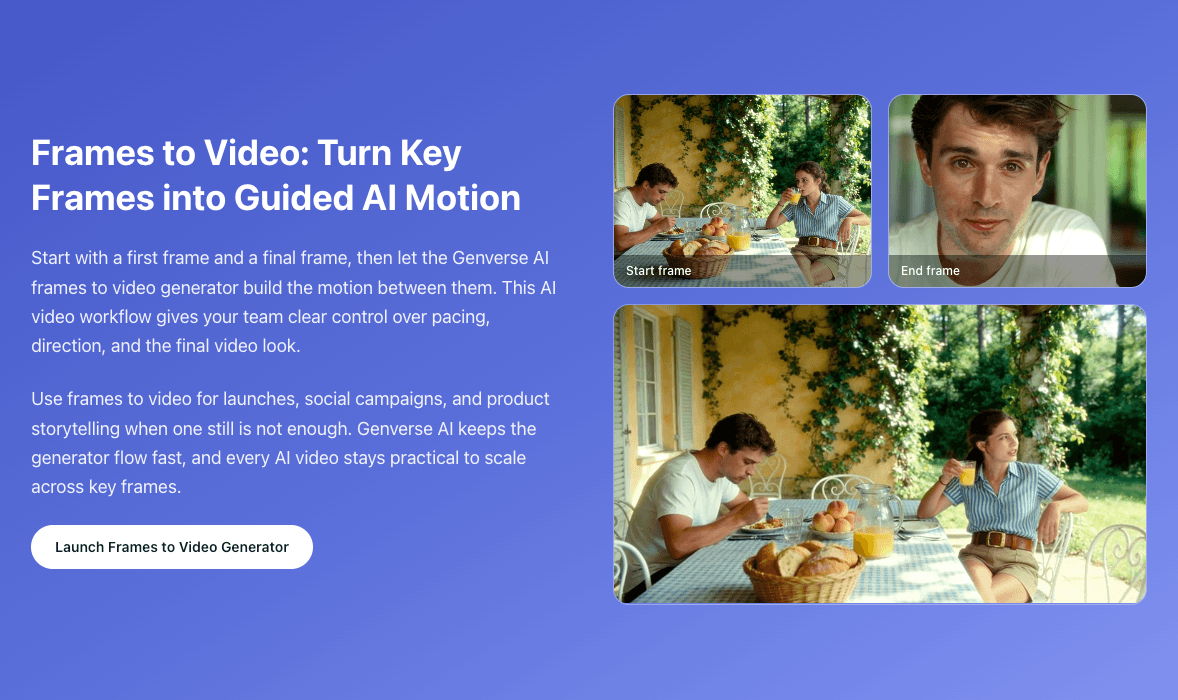

跨帧运动连续性更高

Runway Gen-4 在时间一致性上更强,头发、布料纹理和材质表面等细节更不容易在帧间闪烁或漂移。

复杂多主体场景控制更好

当画面里同时存在多个物体、分层动作和镜头运动时,Runway 更能保持构图关系和空间逻辑,减少画面关系崩坏。

角色动作与情绪表达更有表现力

Runway 对微表情、动作节奏和身体律动的处理更自然,适合叙事短片、代言人口播和品牌故事内容。

为什么 Runway Gen-4 适合日常生产

Runway Gen-4 不只是展示模型,更能融入可重复的编辑流程。

创意团队更快拿到可用首轮结果

Runway 对提示词意图的贴合度更高,团队可以更快判断方向,也能减少修基础运动和构图问题的时间。

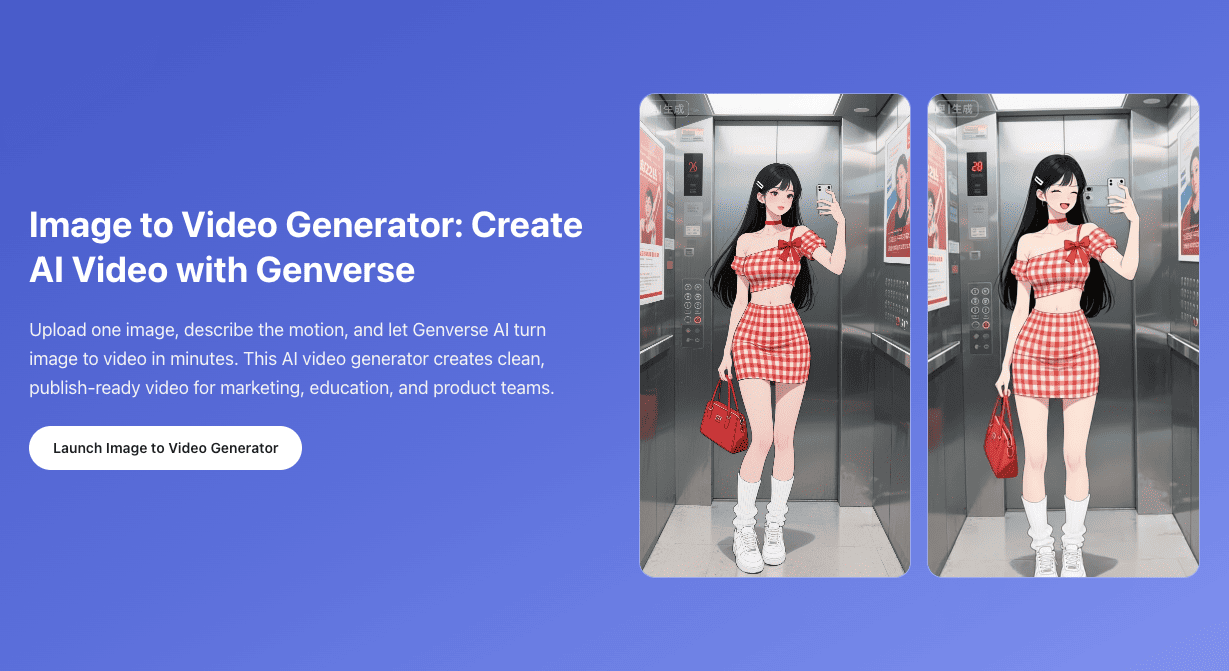

单张参考图也能做出完整叙事感

图生视频可以在保留关键视觉方向的同时加入可控运动,适合活动视觉体系、产品主视觉和品牌资产延展。

对镜头语言提示词更友好

当提示词里写到 pan、truck、orbit、handheld 等镜头语言时,Runway 往往更稳定,镜头规划也更容易预期。

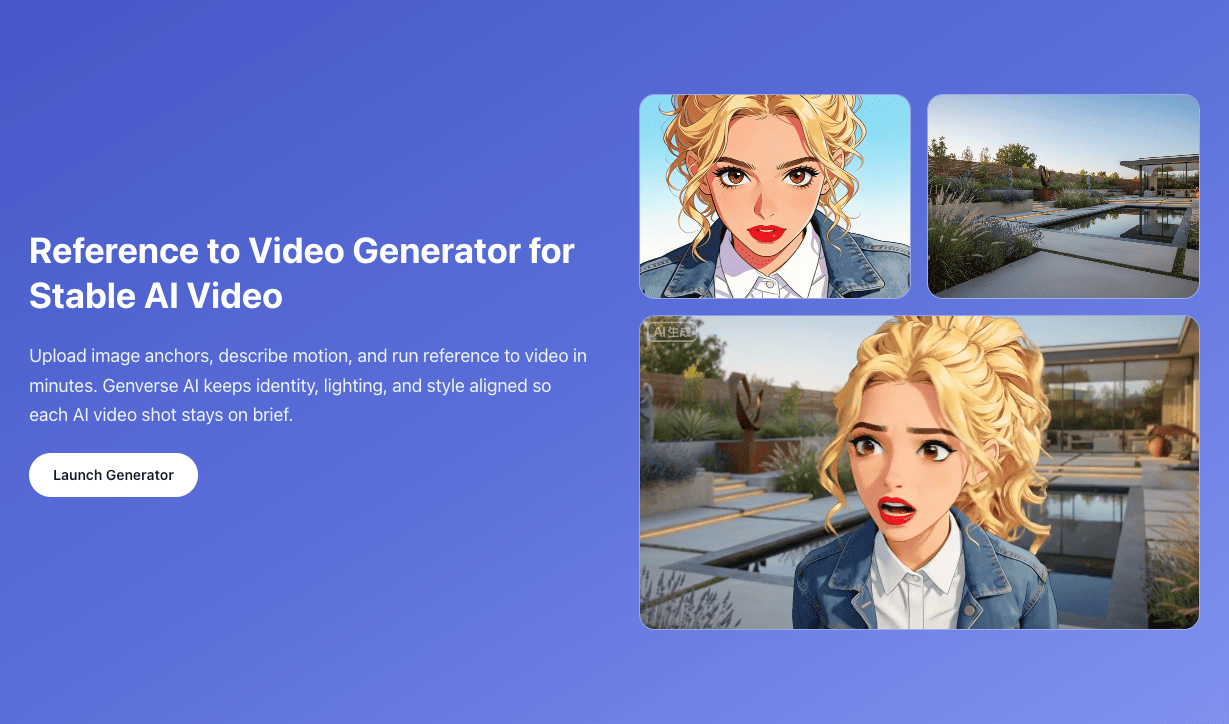

写实和风格化都能保持统一

无论是偏写实场景还是风格化世界观,Runway 都更容易在整段视频中保持审美一致,减少后期修补负担。

团队评审和选版本更高效

Genverse AI 把 Runway 的文生视频与图生视频放在同一处,团队可以并排比对多个版本,更快确定最终方案。

生产参数更贴近实际交付

时长、比例和输出质量在生成过程中始终可见。团队可以让每一轮 Runway 生成直接匹配平台要求,而不是每次重设参数。

如何拿到更好的 Runway Gen-4 输出

用一套聚焦流程,把 Runway 的质量优势稳定转化为生产结果。

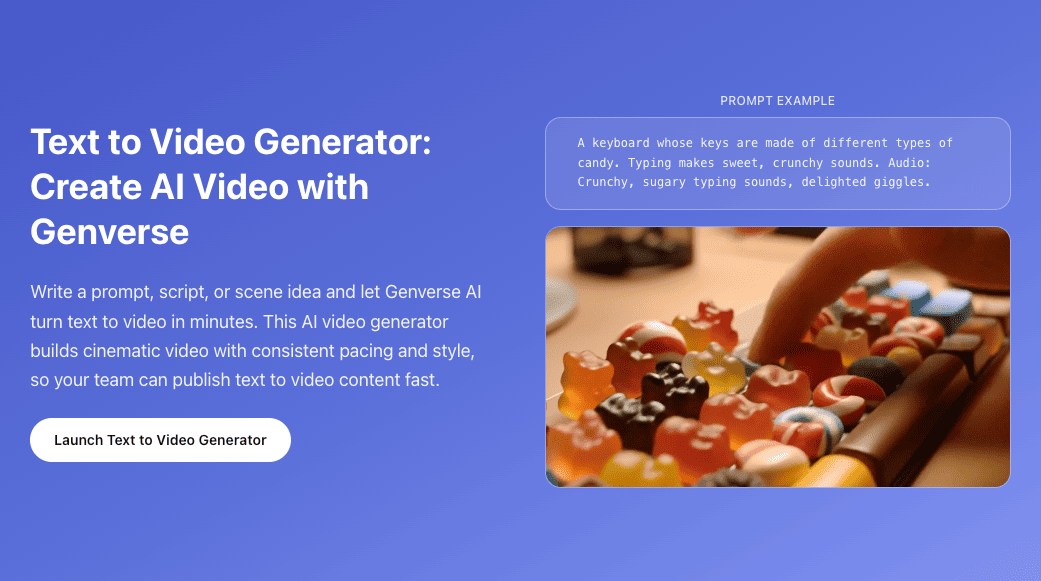

先确定文生视频还是图生视频

还在探索方向时先用文生视频;如果构图、主体身份或视觉语气已被参考图锁定,就从单图开始。

把提示词写到镜头层级

明确描述主体行为、镜头运动、节奏、光线和环境。Runway 对具体、具象、带镜头感的提示词响应更好。

设置时长、画幅和输出质量

根据目标选择 5 秒或 10 秒时长,16:9、9:16、1:1、4:3 或 3:4 画幅,以及 720p 或 1080p 输出。这样能明确区分当前是迭代阶段还是发布阶段。

多跑版本,保留叙事最清晰的一支

进行多轮受控生成,对比运动连续性和构图纪律,最后保留叙事表达最完整、最清楚的版本。

Runway Gen-4 的典型应用场景

当项目在评审中对运动质量和提示词准确度要求更高时,Runway Gen-4 的优势会更明显。

产品发布视频与揭示镜头

适合制作可控的产品主镜头、动态展示和电影感 reveal 段落,这类内容往往直接影响品牌感知。

短视频社媒活动素材

可直接生成适配平台的 Runway 竖版、方版与宽屏素材,用于投放内容、自然流量内容和创作者协作。

概念短片与情绪可视化

把早期创意方向快速变成可动参考,用于团队内部对齐、提案材料和前期故事开发。

角色驱动的品牌叙事

Runway 在表情与动作处理上的优势,让它更适合角色短叙事、代言人场景和强调品牌身份感的内容。

为什么在 Genverse AI 上用 Runway Gen-4

Genverse AI 把 Runway Gen-4 整理成更适合高频交付团队的清晰流程。

聚焦的 Runway 工作区

Runway 生成流程集中在一个工作区,团队能持续保持上下文,不用在多个界面来回跳转。

输入模式清晰,决策更快

可按任务目标在文生视频和图生视频间切换,让每个镜头从最有效的创意输入起步。

关键生产控制项始终可见

Runway 生成时核心参数都在前台,便于把输出直接对齐平台规范和团队评审标准。

适合团队长期复用

Genverse AI 支持可重复的 Runway 生产流程,帮助持续产出的团队在多轮交付中保持稳定质量。

关于 Runway Gen-4 的常见问题

什么是 Runway Gen-4?

Runway Gen-4 是一款面向短视频生成的 AI 视频模型,可基于文本提示词或单张图片生成视频,并重点提升运动质量与画面保真度。

Gen-4 的研究发布传达了什么?

Runway 在 2025 年 12 月发布的研究内容强调了该模型系列在基准表现上的领先,以及在提示词遵循、物理真实感和时间一致性上的明显进步。

这个页面支持哪些工作流?

这个 Runway Gen-4 页面在 Genverse AI 上支持文生视频和图生视频两种工作流。

支持哪些时长、清晰度和比例?

你可以生成 5 秒或 10 秒的 Runway 视频,选择 720p 或 1080p 输出,以及 16:9、9:16、1:1、4:3 或 3:4 画幅比例。

图生视频支持哪些图片格式?

图生视频支持 JPG、JPEG、PNG 作为输入源图,单张图片大小上限为 10MB。

哪些项目最适合 Runway Gen-4?

Runway Gen-4 很适合产品发布、社媒活动、概念短片,以及对运动质量和镜头清晰度要求较高的叙事型短视频项目。

当前视频模型有哪些已知限制?

和其他现代视频模型一样,Runway 在部分复杂场景中仍可能偶发因果顺序不稳定、物体持续性不足,或不合理成功偏向等问题。